Anna Sophie Kümpel, Professorin an der LMU, warnt vor der wachsenden Abhängigkeit von Plattformalgorithmen, die zentrale Sichtbarkeitsstrategien von Medien, Parteien und Unternehmen schwächt. Aktuell spitzen sich Probleme rund um Desinformation, algorithmisch erzeugte Inhalte und die Rolle von KI in sozialen Netzwerken zu; relevant sind Entscheidungen wie der Austausch unabhängiger Faktenchecks durch Community Notes bei Meta und die massiven digitalen Kampagnen, die 2024 Wahlkämpfe beeinflussten. Diese Entwicklung findet in einem Umfeld statt, in dem Informationszugang, Datenanalyse und Automatisierung die Mechanik von Sichtbarkeit bestimmen und damit auch das öffentliche Vertrauen beeinflussen.

Algorithmen und Abhängigkeit: Warum Sichtbarkeitsstrategien an Wirkung verlieren

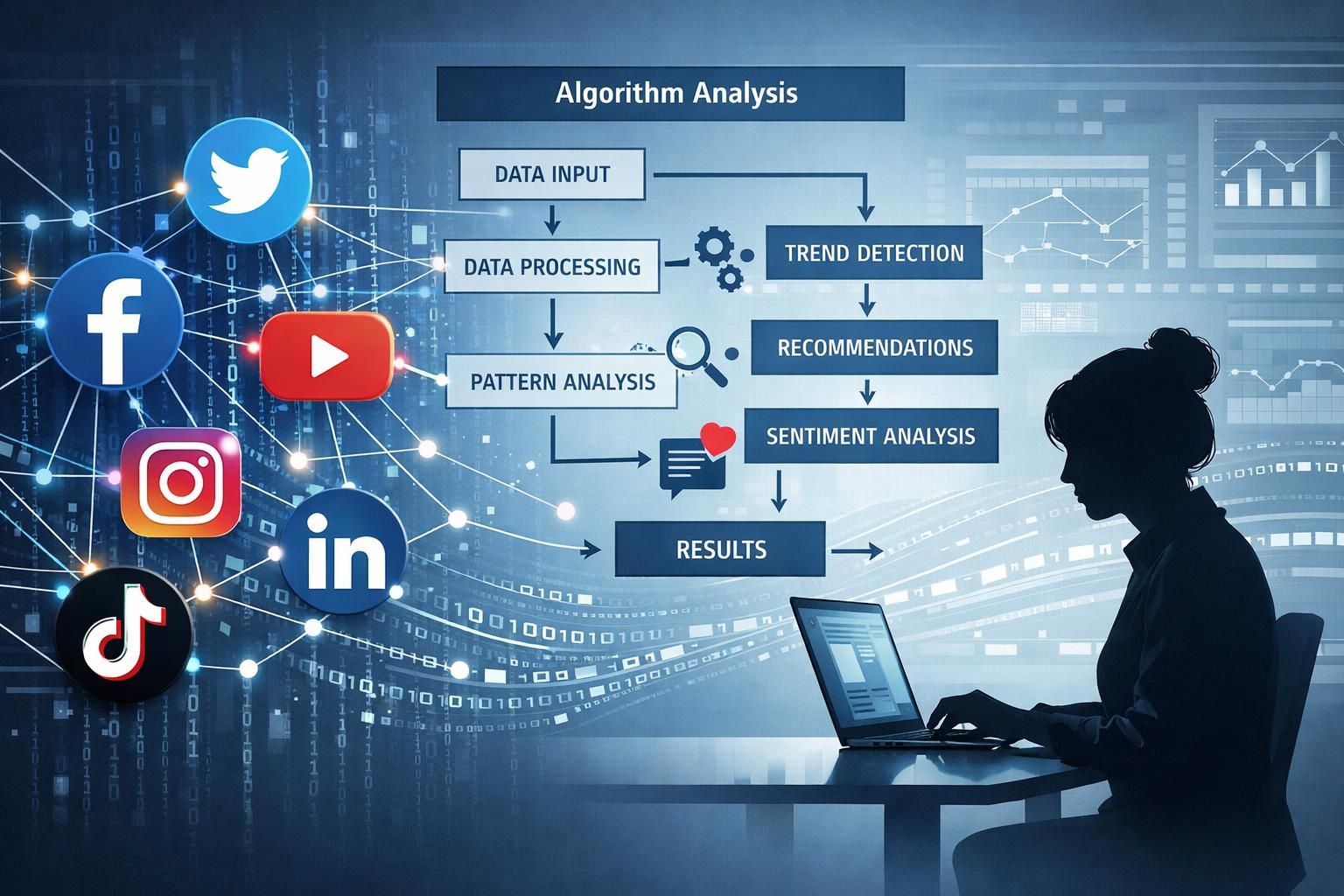

Die zentrale Aussage von Forschenden wie Anna Sophie Kümpel ist, dass Plattformen mit ihren Algorithmen bestimmen, welche Inhalte sichtbar werden. Diese Systeme priorisieren Engagement und erzeugen so eine hohe Abhängigkeit für Akteure, die Reichweite erzielen wollen.

Konkrete Mechanismen und aktuelle Entscheidungen

Plattformen wie Instagram, TikTok und X passen ihre Ranking-Logiken ständig an; das veränderte Auftreten politischer Inhalte auf X nach jüngsten Anpassungen ist ein Beispiel. Zudem hat Meta Entscheidungen zur Reduzierung unabhängiger Faktenchecks getroffen, was Forscherinnen wie Kümpel als problematisch einstufen.

Auswirkungen auf Digitales Marketing und Sichtbarkeitsstrategien

Unternehmen und Parteien sehen sich gezwungen, Suchmaschinen– und Plattformlogiken zu berücksichtigen. Klassische PR- und Content-Strategien verlieren an Vorhersehbarkeit, weil Automatisierung und algorithmische Präferenzen das Ranking stark beeinflussen.

Wie KI, Automatisierung und Datenanalyse Manipulationsrisiken erhöhen

Die Kombination aus KI-gestützter Content-Produktion, gezielter Datenanalyse und professioneller Plattformnutzung hat neue Formen der Sichtbarkeit geschaffen – oft mit destabilisierenden Effekten auf den öffentlichen Diskurs.

Beispiele und Befunde aus Wahlkämpfen

Das Superwahljahr 2024 zeigte, wie Influencerinnen, Parteien und internationale Akteure algorithmische Schwachstellen nutzten. So erreichten laut Untersuchungen zahlreiche AfD-Seiten auf Facebook hohe Engagementraten; Kampagnen auf TikTok zielten speziell auf Erstwählerinnen.

Technische und psychologische Hebel

Algorithmen belohnen emotionalisierende Inhalte, was Hatespeech und Desinformation verstärkt. Modelle zur Personalisierung können Millionen Varianten an Botschaften erzeugen und für spezifische Zielgruppen optimieren – ein Effekt, der durch Automatisierung verstärkt wird.

Konsequenzen für demokratische Informationsräume und Handlungserwartungen

Die Fragmentierung des Informationsraums schwächt gemeinsame Referenzrahmen und fördert Polarisierung. Studien und Berichte, darunter das World Economic Forum und das Reuters Institute, zeigen abnehmendes Vertrauen und eine wachsende Abhängigkeit von Internetquellen.

Regulatorische und zivilgesellschaftliche Antworten

Forderungen reichen von einem Verhaltenskodex für Parteien bis hin zu mehr Transparenz bei Plattformen. Forschende wie Kümpel plädieren für offene Datenzugänge und standardisierte Einsichten in Ranking– und Datenanalyse-Prozesse, damit Manipulationspfade nachprüfbar werden.

Folgen für Medienhäuser und Digitales Marketing

Medien müssen ihre Strategien neu ausrichten: Diversifizierte Publikationskanäle, eigene Newsletter und verstärkte Qualitätskennzeichnung sollen die Abhängigkeit von Fremdalghorithmen reduzieren. Für das Digitale Marketing bedeutet das eine Investition in langfristige Vertrauenserzeugung statt kurzfristiger Reichweitenmanipulation.

Die Debatte bleibt offen: Mehr Transparenz bei Algorithmen, klare Regeln für KI-Inhalte und gestärkte Aufklärung über Manipulationsmechanismen gelten als zentrale Schritte, um die Schwächung klassischer Sichtbarkeitsstrategien umzukehren und den Informationszugang in demokratischen Gesellschaften zu sichern. Forschende der LMU arbeiten bereits an Methoden, personalisierte Feeds nachzubauen, um diesen Herausforderungen empirisch zu begegnen und technische Gegenstrategien zu entwickeln.